Computergestützte Navigation

Computergestützte Navigation (Computer Assisted Navigation - CAN) in der Tumorchirurgie ist ein schnell wachsendes Forschungsfeld. CAN-Systeme ermöglichen es Chirurginnen und Chirurgen, Tumoren präzise zu identifizieren und zu entfernen, während gleichzeitig umliegendes gesundes Gewebe geschont wird – mit dem Ziel, sowohl onkologische als auch funktionelle Behandlungsergebnisse zu verbessern. Unsere Forschung in diesem Bereich konzentriert sich auf die Steigerung von Geschwindigkeit, Genauigkeit und Präzision weichteilbasierter Navigationssysteme. Zudem entwickeln wir neue Methoden zur Generierung realer und synthetischer Datensätze, die für das Training benötigt werden, und integrieren Ground-Truth-Daten nicht nur in den intraoperativen Ablauf, sondern auch in die präoperative chirurgische Planung.

Wir bearbeiten ein breites Spektrum an Fragestellungen von maschinellen Lernverfahren zur Verbesserung chirurgischer Systeme bis hin zu klinischen Aspekten intraoperativer Anwendungen, stets mit dem Ziel, individuellere Behandlungen und eine bessere Lebensqualität für Patient: innen mit Krebserkrankungen zu ermöglichen.

Unser Team erforscht Methoden, entwickelt Algorithmen und erstellt Datensätze für folgende Bereiche:

- 3D-Rekonstruktion, Tiefenschätzung, Kamerakalibrierung

- Intraoperative Segmentierung

- Starre und nicht-starre Registrierung

- Modellierung von Weichgewebe

- Benutzerinteraktion und -eingriffe

- Augmented Reality & Benutzerschnittstellen

Foschungsthemen

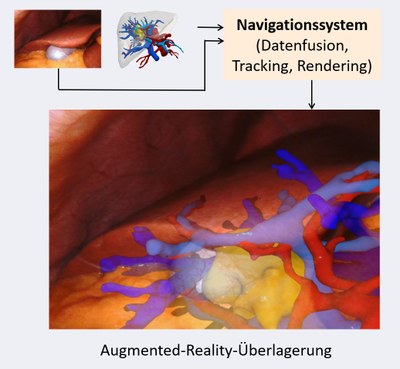

Ziel der intraoperativen Navigation ist es, der Chirurgin bzw. dem Chirurgen in Echtzeit Informationen über die Lage kritischer Strukturen, wie Blutgefäße, Nerven und den Tumor selbst, bereitzustellen. Diese Informationen basieren auf präoperativen Planungsdaten, etwa CT- oder MRT-Aufnahmen der Patientenanatomie, und werden mithilfe von Augmented-Reality-Technologie (AR) über das Sichtfeld im Operationsgebiet gelegt. Bei der Navigation in Weichgewebe, beispielsweise bei Leberoperationen, stellt die Deformation von Organen und Gewebe eine besondere Herausforderung dar. Organe können sich während des Eingriffs verschieben und ihre Form verändern, was die präzise Echtzeit-Verfolgung erschwert. Zudem können unterschiedliche Patientenlagerungen sowie individuelle Atembewegungen die Genauigkeit des Navigationssystems zusätzlich beeinflussen.

Zur Bewältigung dieser Herausforderungen entwickeln wir neue Methoden, die die Deformation von Organen und Geweben berücksichtigen können. Dazu zählen fortschrittliche bildgebende Verfahren in Echtzeit, die während des Eingriffs aktuelle Informationen über die Lage kritischer Strukturen liefern. Ein zentraler Fokus unserer Forschungsgruppe liegt auf dem Einsatz neuartiger maschineller Lernverfahren, mit denen sich die Gewebeverformung auf Basis intraoperativer Beobachtungen vorhersagen lässt. Dadurch kann das Navigationssystem die Position relevanter Strukturen präziser und in Echtzeit nachverfolgen.

Wir erforschen insbesondere den Einsatz von tiefen neuronalen Netzen zur Registrierung zwischen präoperativem und intraoperativem Zustand. Diese Netzwerke können mit einer Kombination aus realen und synthetischen Daten trainiert werden, um relevante korrespondierende Merkmale zu erkennen und die Deformation zwischen den beiden Zuständen zuverlässig zu schätzen.

Die Gewinnung geeigneter Daten für das Training und die Evaluierung von Algorithmen stellt im Bereich der Computergestützten Interventionen (Computer Assisted Interventions - CAI) eine zentrale Herausforderung dar. Während in anderen Bereichen häufig das Labeling als Hauptproblem gilt, kommen im CAI zusätzliche Hürden hinzu: Datenschutz, der hohe Anteil an Ausnahmepatientinnen und -patienten, fehlende Standardisierung und das häufige Fehlen von Ground Truth. Ein Beispiel: Eine Ground-Truth-Tiefenkarte eines intraoperativen Videos wäre für Navigationsalgorithmen äußerst hilfreich – ist jedoch im chirurgischen Kontext nur sehr schwer zu erheben. Zudem ist die manuelle Annotation von Daten zeitaufwendig und muss in der Regel durch medizinische Expertinnen und Experten erfolgen.

Simulation und synthetische Datengenerierung bieten angesichts dieser Probleme viele Vorteile. Synthetische Daten sind kontrollierbar, nahezu unbegrenzt verfügbar, leicht zugänglich und problemlos teilbar. Sie können mit hoher Standardisierung und bekannter Ground Truth generiert werden – ideal für die Vergleichbarkeit von Ergebnissen zwischen verschiedenen Forschungsgruppen sowie zur objektiven Bewertung algorithmischer Genauigkeit.

In unserer Forschungsgruppe werden synthetische Daten in verschiedenen Projekten zur Entwicklung und Evaluierung von Machine-Learning-Algorithmen für reale klinische Anwendungen genutzt. Sowohl die Simulationsmethoden als auch die erzeugten Datensätze werden häufig von uns veröffentlicht.

Datengetriebene Simulationspipelines

Öffentlich zugängliche Datensätze, die z. B. dieselbe Leber in verschiedenen Deformationszuständen zeigen, sind kaum verfügbar. Um unsere ML-Algorithmen für Navigation und Registrierung zu trainieren, entwickeln wir eigene Simulationspipelines zur Erzeugung synthetischer Deformationen, sowohl für reale als auch virtuelle Organe.

Dabei bauen wir auf biomechanisch realitätsnahe Modelle, um große Mengen semirealistischer Daten zu generieren, mit denen leistungsstarke neuronale Netze trainiert werden. Die Simulationen basieren auf komplexen physikalischen Modellen, die das Verhalten von Organen unter verschiedenen Deformationseinflüssen nachbilden. Eine der größten Herausforderungen besteht darin, die physikalischen Eigenschaften und Verformungsmodelle realitätsgetreu zu konstruieren – einschließlich geometrischer, biomechanischer und gewebespezifischer Eigenschaften.

Ziel unserer Forschung ist es, realistische und vielfältige synthetische Daten mit präziser Annotation zu generieren, die tatsächlichen Operationsszenarien entsprechen. Zur Validierung der Modelle und Erzeugung von Ground-Truth-Deformationsdaten kombinieren wir mathematische und numerische Modellierungstechniken mit realen Patientinnen- und Patientendaten, etwa medizinische Bildgebung oder physiologische Parameter. Zusätzlich nutzen wir Data Augmentation durch zufällige Transformationen und komplexere Modellierungsansätze, um die synthetischen Daten möglichst realitätsnah und vielfältig zu gestalten.

Neurales Rendering in der Chirurgie

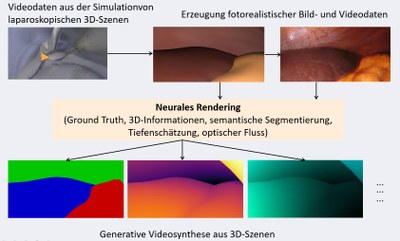

Im chirurgischen Bereich stellt die Gewinnung von Ground-Truth-Daten für Computer-Vision-Aufgaben fast immer einen entscheidenden Engpass dar. Dies gilt insbesondere dann, wenn die Ground Truth zusätzliche Sensorik (z. B. Tiefendaten, Kameraposen, 3D-Informationen) oder eine feingranulare Annotation (z. B. semantische Segmentierung) erfordert. Unser Ziel ist es daher, aus einfachen chirurgischen Simulationen, etwa laparoskopischen 3D-Szenen, fotorealistische Bild- und Videodaten zu generieren. Hierzu nutzen und entwickeln wir Methoden aus aufstrebenden Forschungsfeldern wie dem neuralen Rendering und der generativen Bildsynthese. Die so erzeugten synthetischen visuellen Daten, kombiniert mit umfangreicher Ground Truth, können anschließend als Trainings- oder Evaluierungsdaten für eine Vielzahl von Computer-Vision-Aufgaben eingesetzt werden, etwa für SLAM, Tiefenschätzung oder semantische Segmentierung.

Open-Access-Datasätze

- Bild-zu-Bild Übersetzung bei laparoskopischen Aufnahmen

- Langfristig zeitlich konsistente Videoübersetzung

Gruppenmitglieder

- Micha Pfeiffer (Postdoc, Gruppenleiter)

- Maxime Fleury (Wissenschaftliche Softwareentwicklung)

- Gregor Just (Doktorand)

- Reuben Docea (Doktorand)

- Peng Liu (Doktorand)

- Johannes Bender (Doktorand)

- Bianca Güttner (Doktorand)

- Danush Kumar Venkatesh (Doktorand)

- Jinjing Xu (Doktorand)

- Lorenzo Mazza (Doktorand)

- Chenyang Li (Doktorand)

- Stefanie Speidel (Professorin, Principal Investigator - PI)